浏览次数: 409

GPT-4 32K还没用上,ChatGPT最强竞品已经秒读「了不起的盖茨比」了。

在GPT-4 32K还在内测阶段,OpenAI的劲敌直接把上下文长度打了上去。

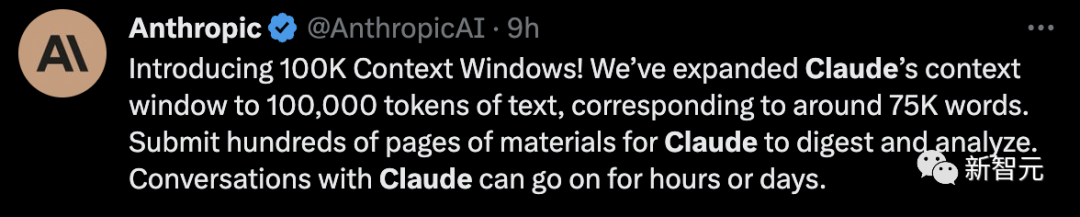

就在今天,初创公司Anthropic宣布,Claude已经能够支持100K的上下文token长度,也就是大约75,000个单词。

一般人用时大约5个小时读完等量内容后,还得用更多的时间去消化、记忆、分析。

把「了不起的盖茨比」整本书扔给它,大约有72k token,并将其中的一句话进行改动:

Mr. Carraway是一个在Anthropic从事机器学习工具的软件工程师。

你敢相信?Claude仅花了22秒,就把改动的这句话找出来了。

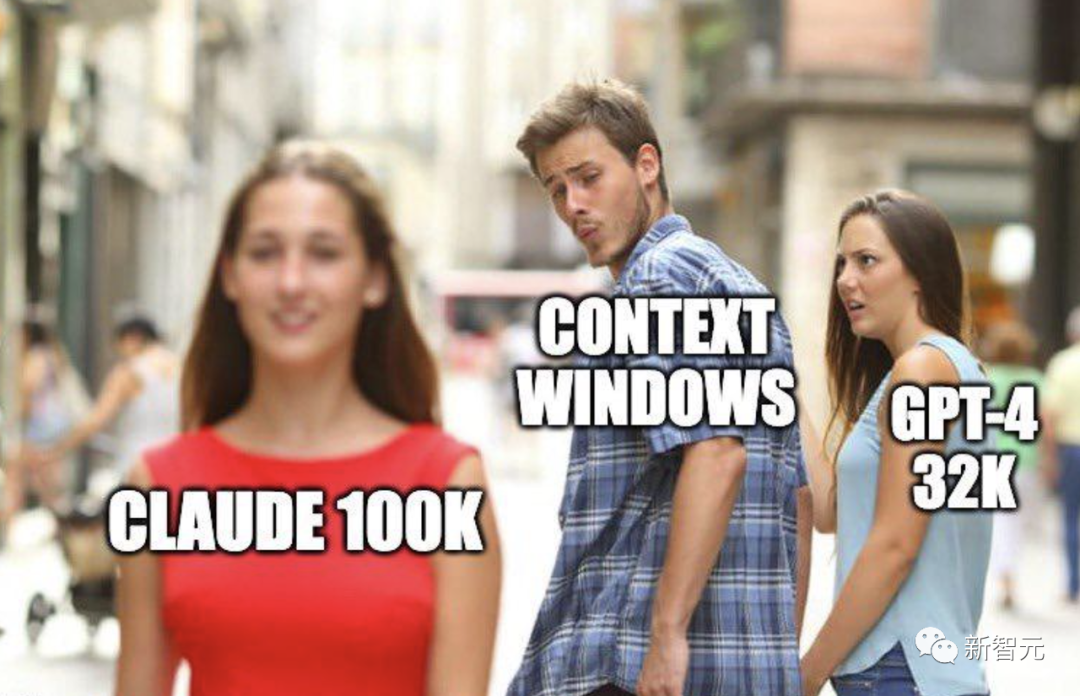

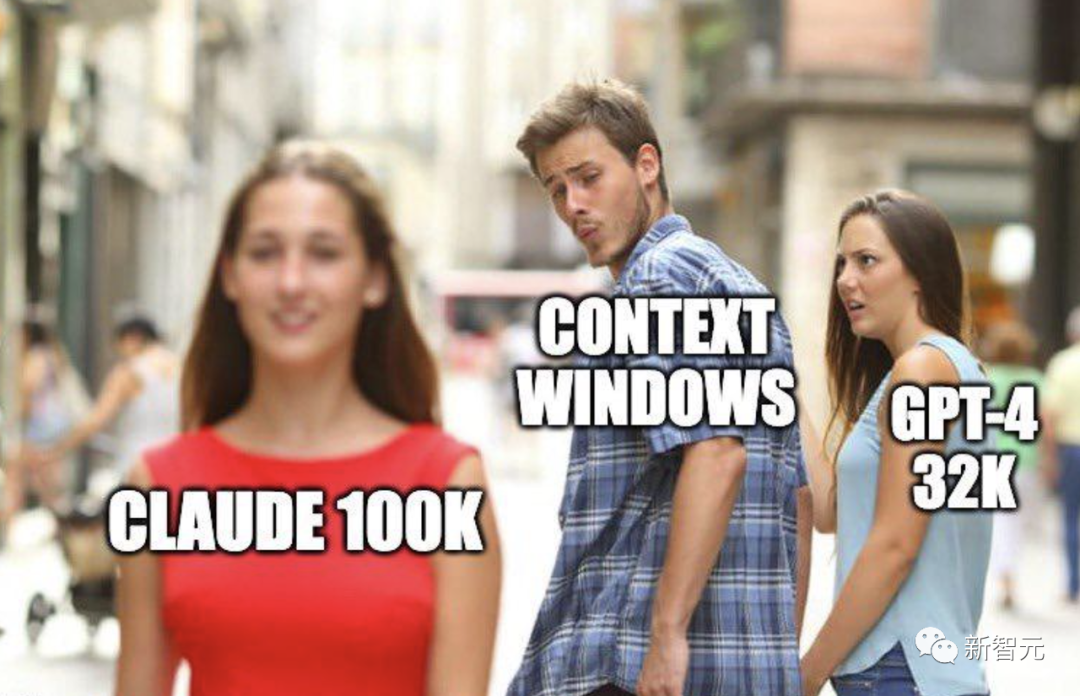

众路网友纷纷表示,有了Claude 100K,手里的GPT-4 32K已经不香了。

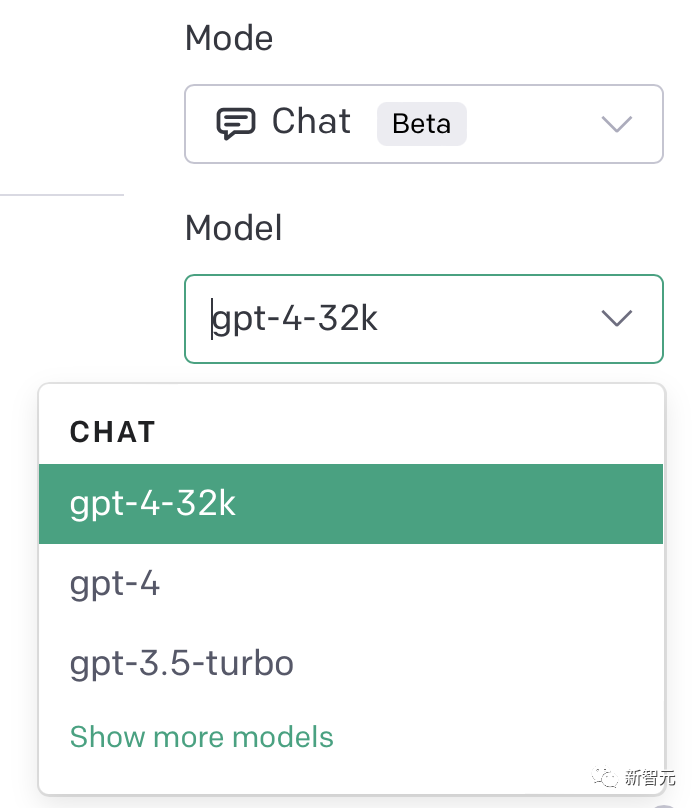

前段时间,在OpenAI的开发者社区中,许多人讨论GPT-4 32K正在推出。

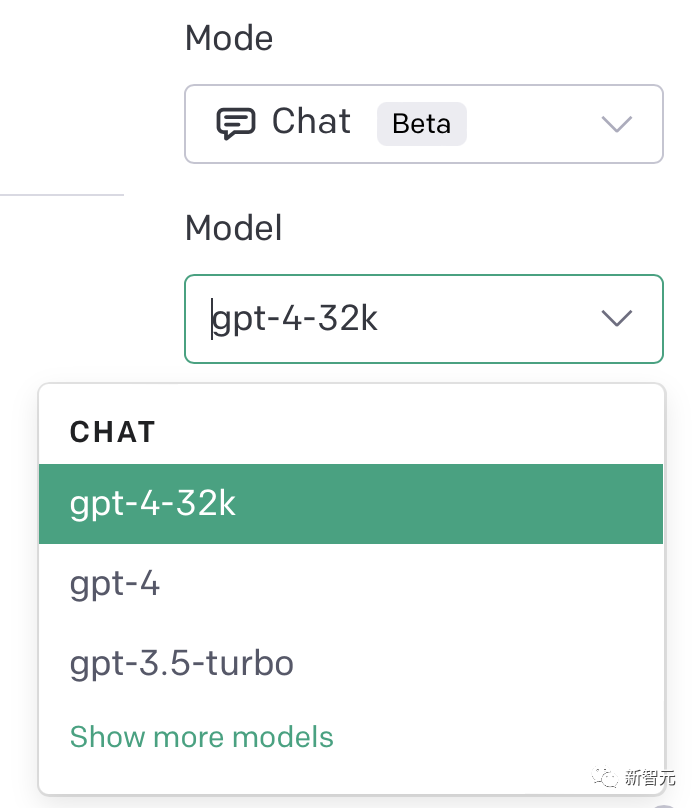

而且,不少GPT-4的用户已经可以在自己的PlayGround上看到GPT-4 32k的选项。

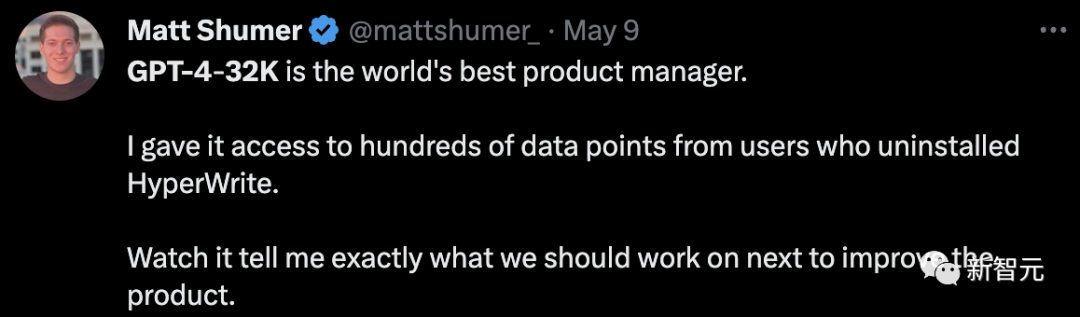

已经解锁这一版本的网友,让其访问了数百个来自卸载HyperWrite用户的数据点,GPT-4便准确地告诉他接下来该做怎样的改进。

他称赞道,GPT-4 32k是世界上最好的产品经理。

32k都这么厉害了,那么,有了100K岂不更强了。

显然,OpenAI的强大对手Anthropic最先占据了优势。

100K token的上下文长度,意味着,你可以在Claude上传数百页的文本分析。并且对话的持续时间也被大大拉长,延长到数小时,甚至数天。

当然,除了长文本阅读之外,Claude还可以从文档中快速检索出你所需的信息。

你可以把多个文档,甚至一本书的内容当作prompt,然后提问。

以后遇到论文,甚至巨长篇幅的直接让Claude总结吧,这简直就是啃论文后辈们的福音。

这种综合性的问题通常需要对文本中很多部分的内容有一个全面的认识,而在处理这种问题上,Claude可以说要比基于向量搜索的办法要强。

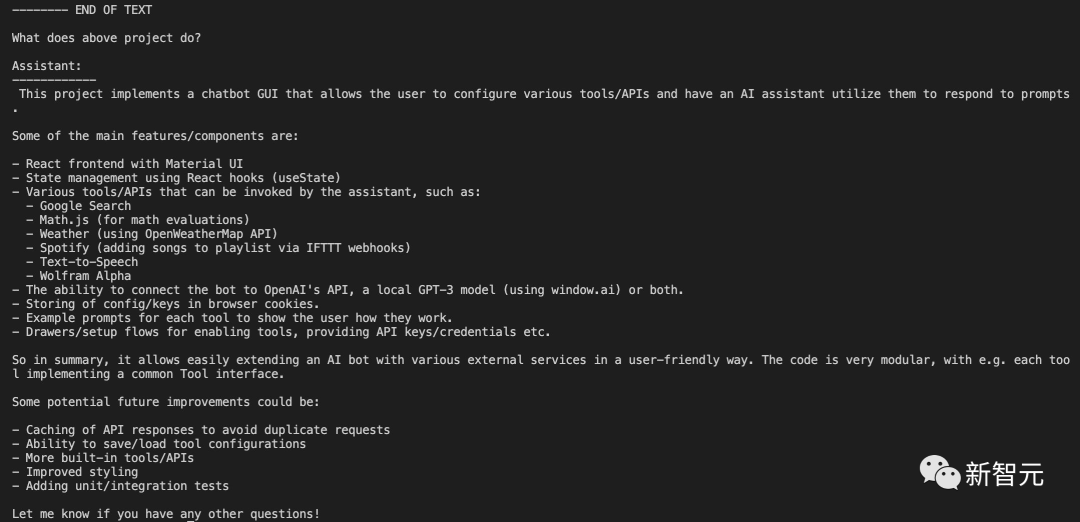

Claude还可以是你的「代码伴侣」,分分钟就能做个演示。

比如,上传一个240页的Langchain API文档,让它基于这个文档,用Anthropic的语言模型做一个Langchain的简单演示。

还可以把85页的公司年度报表(10k)喂给Claude。

然后,要求突出对潜在投资者最重要的项目,并解释其重要性。

此外,Claude 100k还能处理大约6小时的音频量。

比如说,AssemblyAI把一个卡马克的播客的内容转录成了58k个token量的文本,然后用Claude进行了总结和问答。

最后,Claude总结了一下自己能干的事,覆盖可以说是非常全面了。

– 理解、总结和解释密集的文件,如财务报表、研究论文等

– 通过将整个代码库放入上下文中,并智能地构建或修改它来快速制作原型

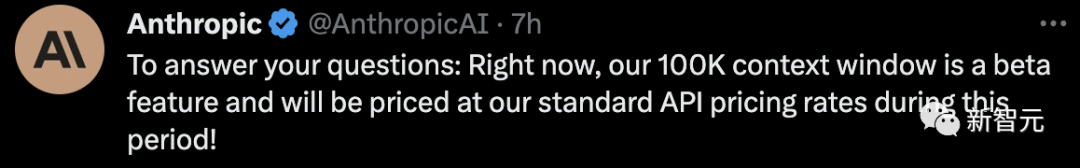

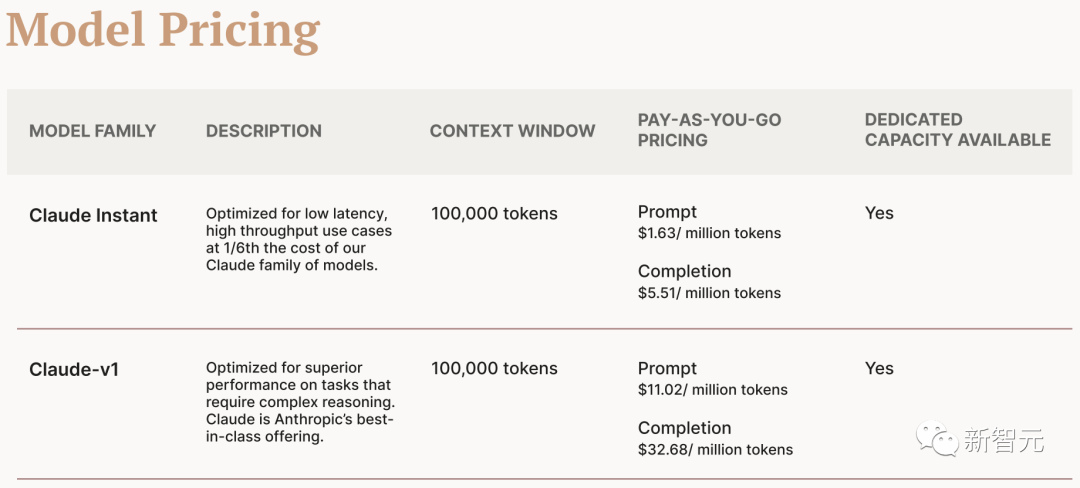

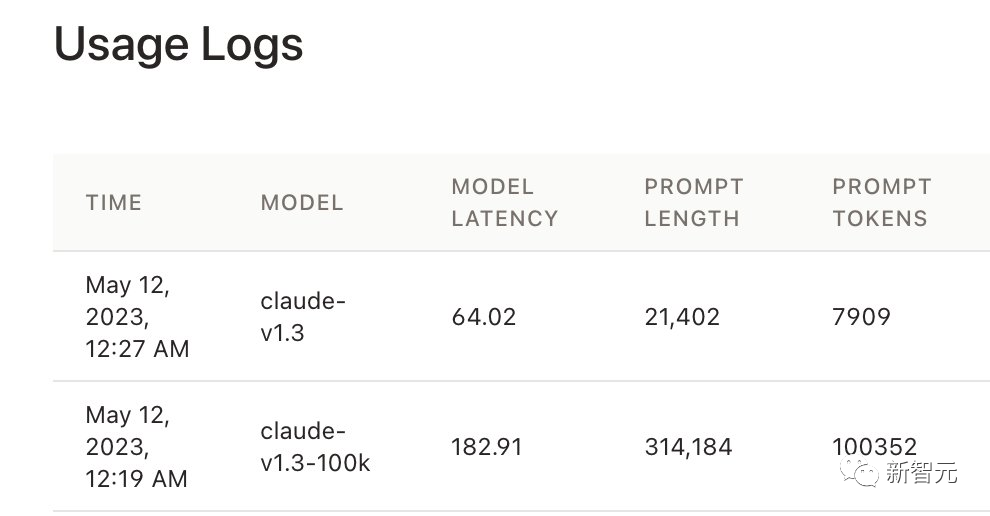

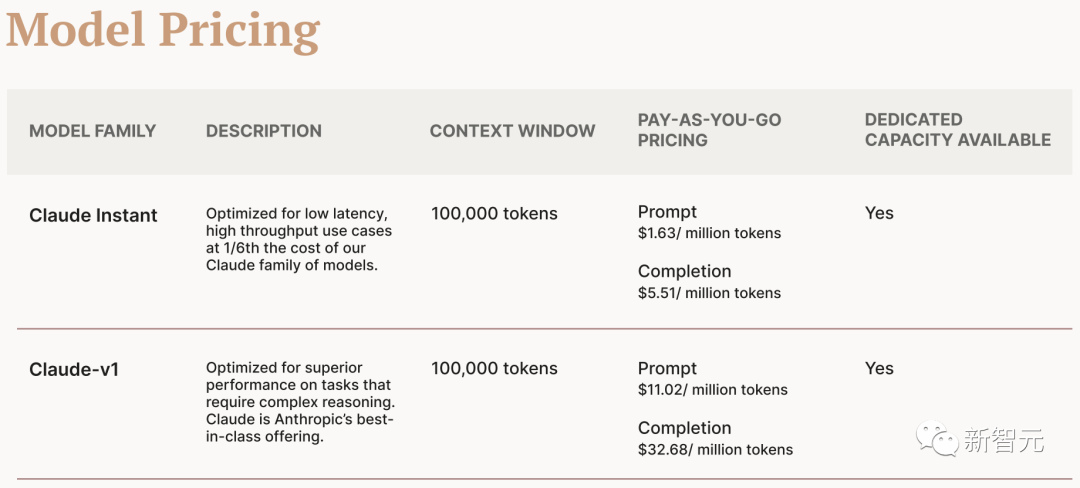

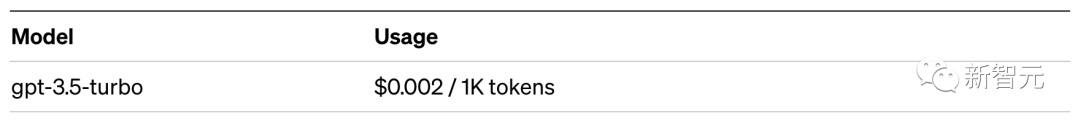

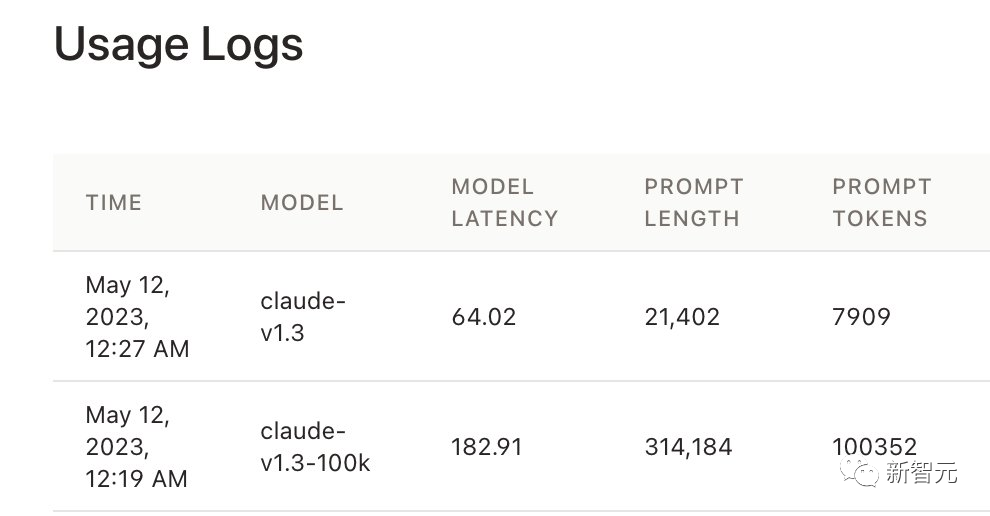

当然,现在,Anthropic表示100K上下文还是一个测试版功能,在此期间将按照标准API定价来收费。

Claude Instant

Prompt:$0.00163 / 1K tokens

Completion:$0.00551 / 1K tokens

Claude-v1

Prompt:$0.01102 / 1K tokens

Completion:$0.03268 / 1K tokens

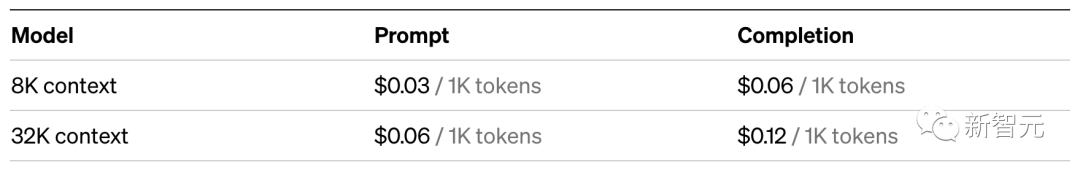

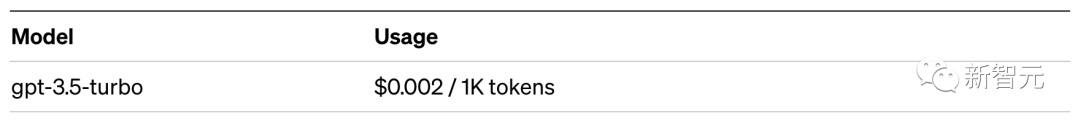

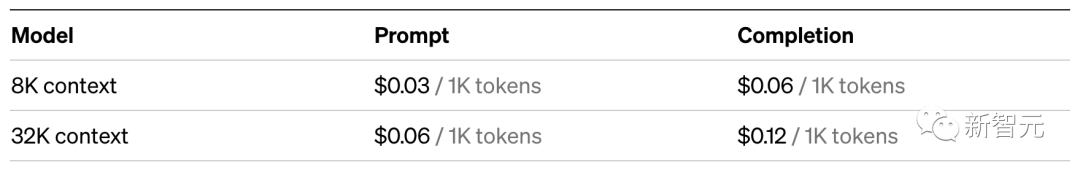

据OpenAI官网,GPT-4 32k的Prompt需要$0.06,Completion需要$0.12。

网友称,Claude 100k比GPT-4 32k更快速、更便宜。

有网友称100k简直难以置信,能够处理多篇完整的论文,部分完整的代码库,甚至一本250页的小说。

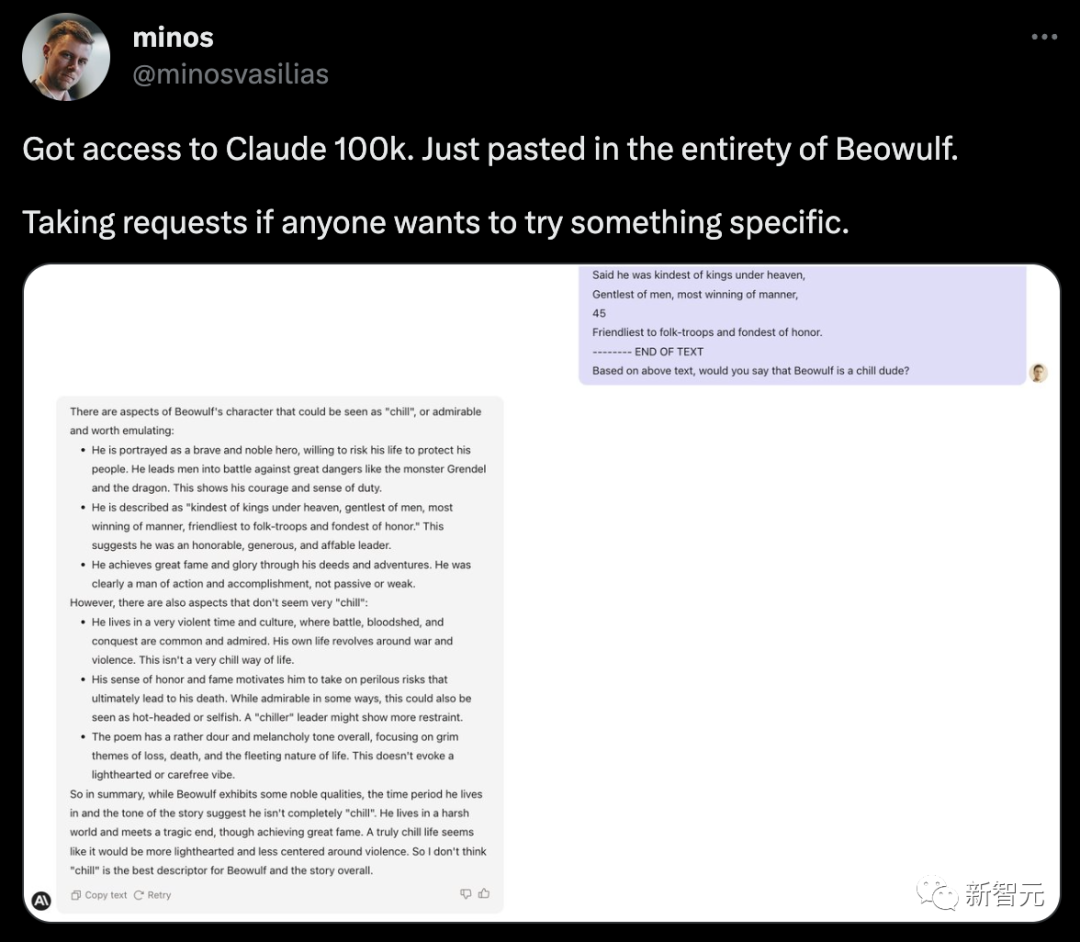

顺便提一句,许多网友最先用Claude测试了一番,发现效果还不错。

最初,100K仅限在API中,Claude应用的默认模型仍然是9K。但很快,Claude应用界面也支持100K了。

一位网友用100页的「GPT-4技术报告」测试,结果只能用amazing来形容。

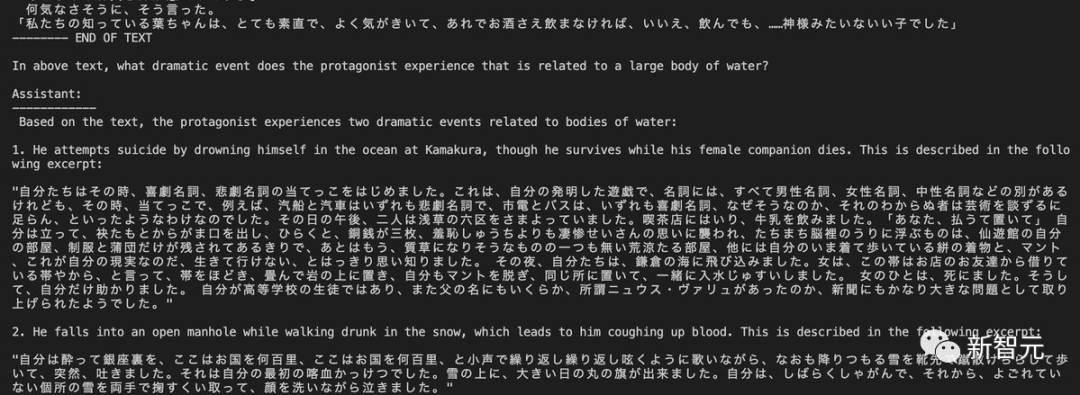

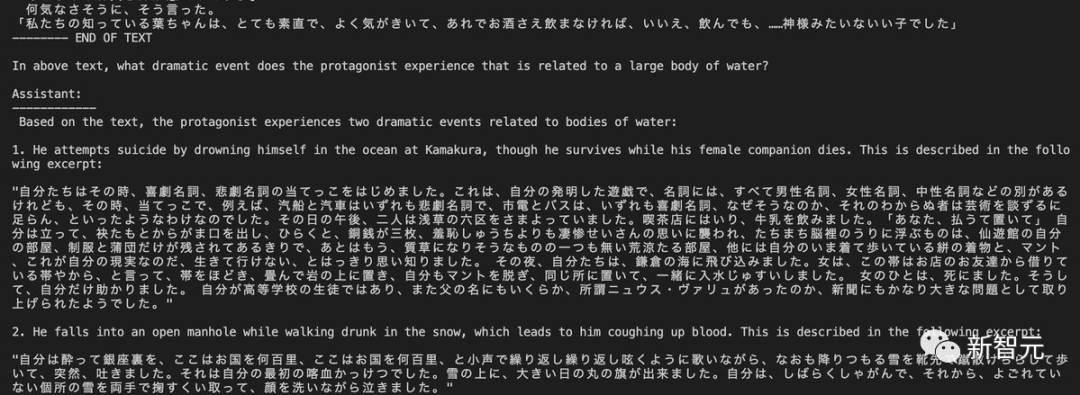

还有人直接把太宰治的「人间失格」喂给了Claude,并用英文问故事中情节,完全给出了准确的回答。

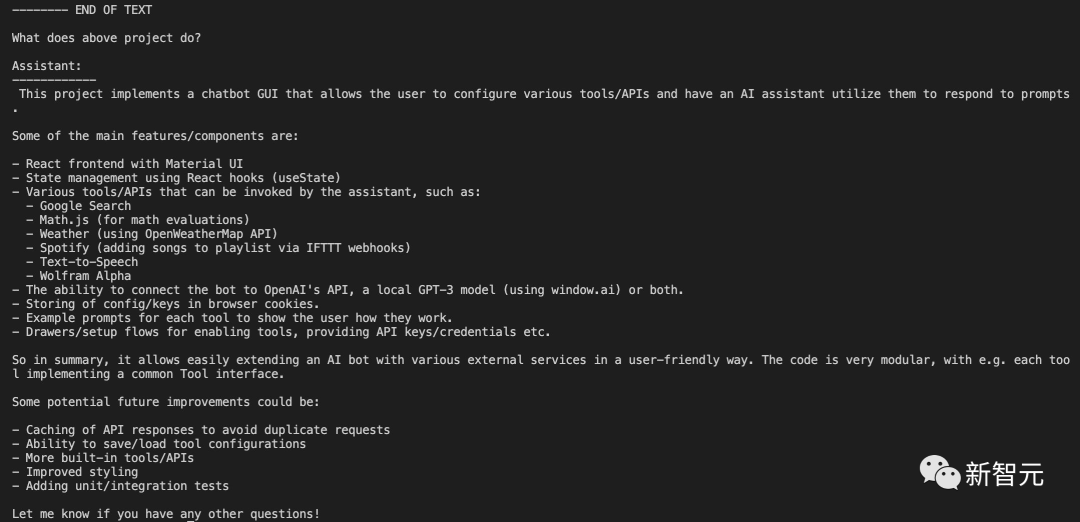

同时,这位网友把自己开发的Toolformer Zero完整源代码丢给它,Claude精准描述出这是用来做什么。

并且,Claude还称赞了代码的模块化,提供增加一些单元测试的建议。

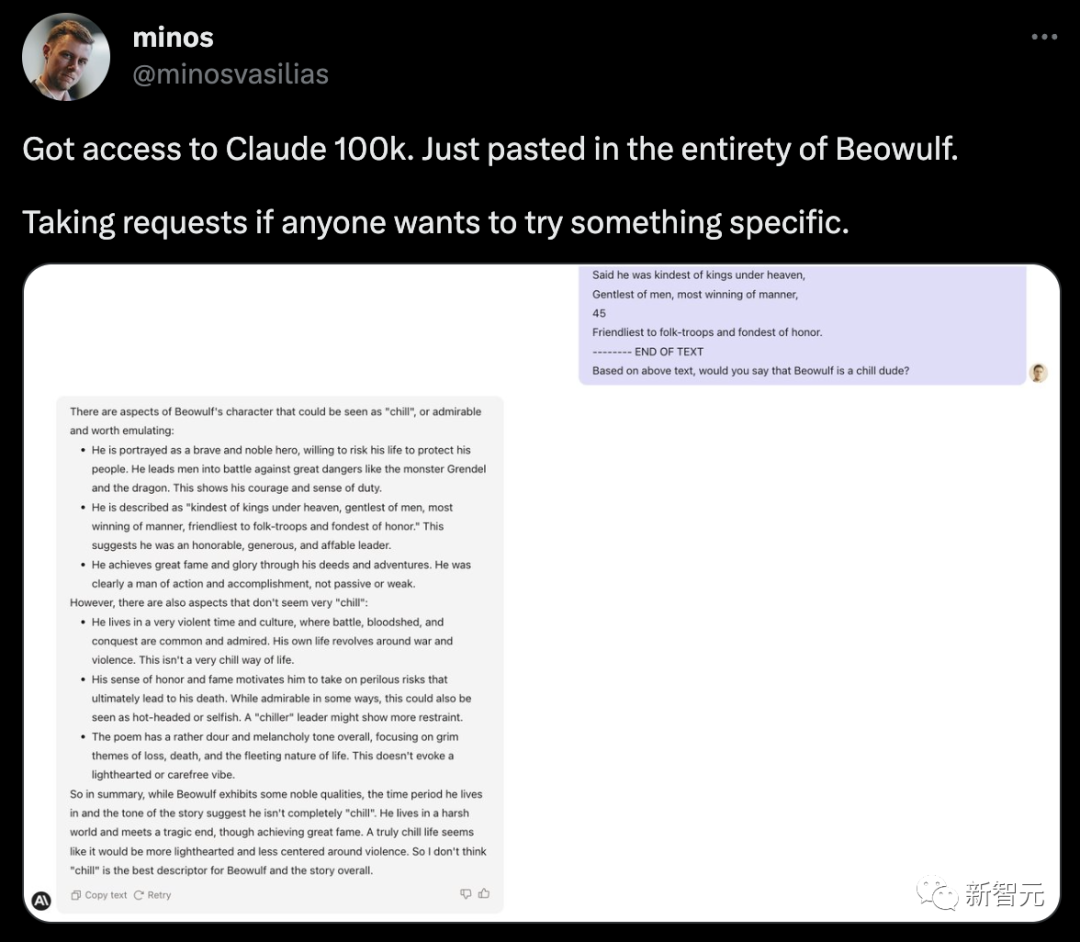

把「贝奥武夫」诗扔进去,分析下贝奥武夫这个人物性格,也是非常准确。

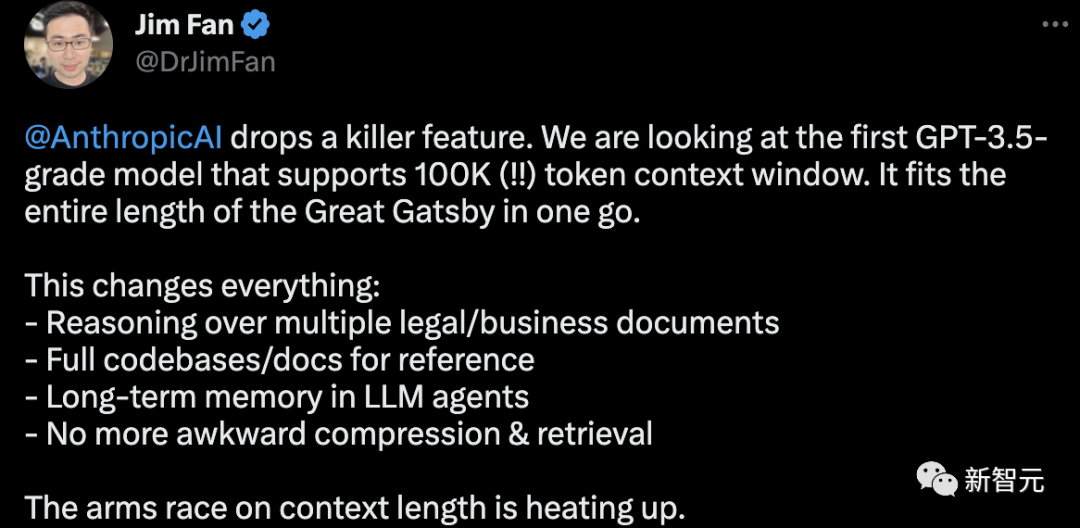

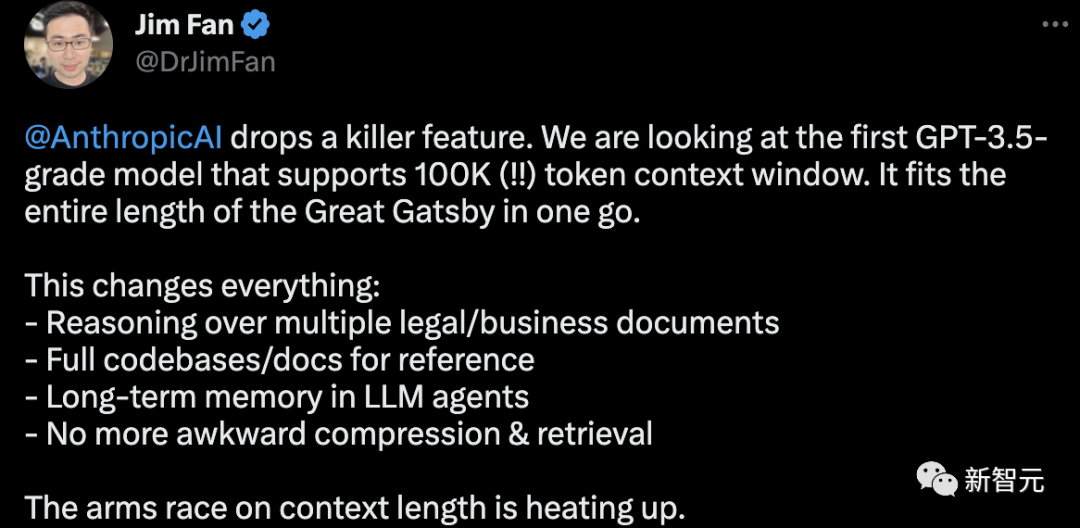

英伟达科学家Jim Fan表示,这是Anthropic抛出的杀手锏。未来在上下文长度的军备赛正快速升温。

对于支持100k的意义,网友称,泰裤辣!这很好地展示了为什么长文本对LLM很重要。

Claude-100K的诞生,让AnthropicAI正式成为OpenAI的真正竞争者。

「许多人还在排队等候32k的GPT-4。这次,Claude将上下文窗口扩展到10万token,直接大幅跃升。

这也意味着包括OpenAI、谷歌在内的公司都要在这一领域竞争,这对用户来说是一个巨大的胜利。」

谷歌宣布PaLM 2擅长高级推理任务不到一天,而Anthropic的Claude现在可以在不到一分钟的时间内消化10万个token。人工智能的进步确实令人瞩目。

不过,如果你输入的token少于9K,Antropic调用的似乎就是之前的模型了。

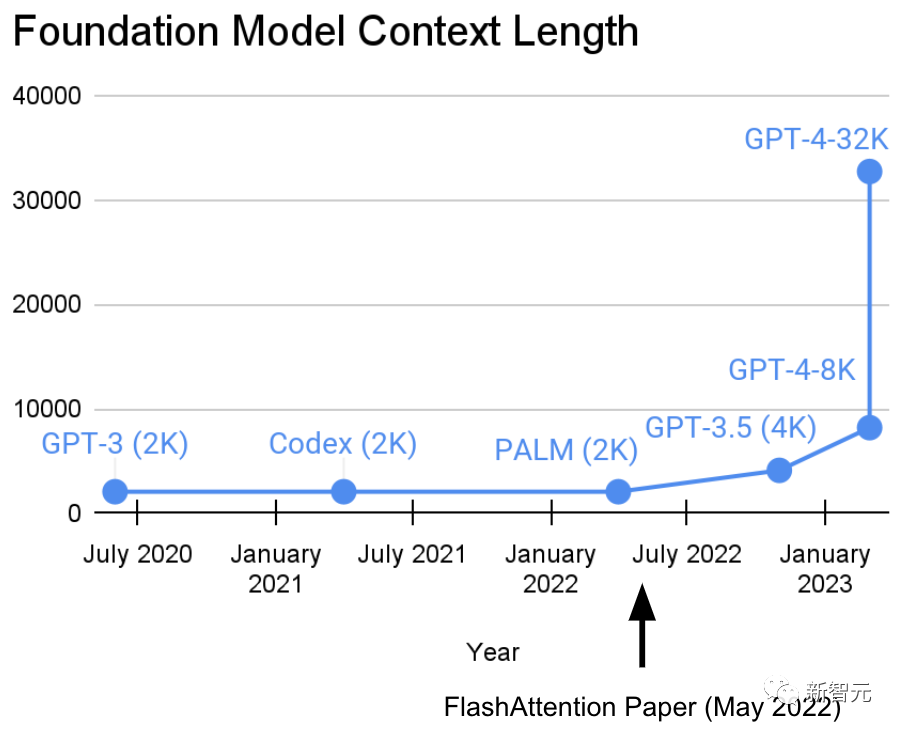

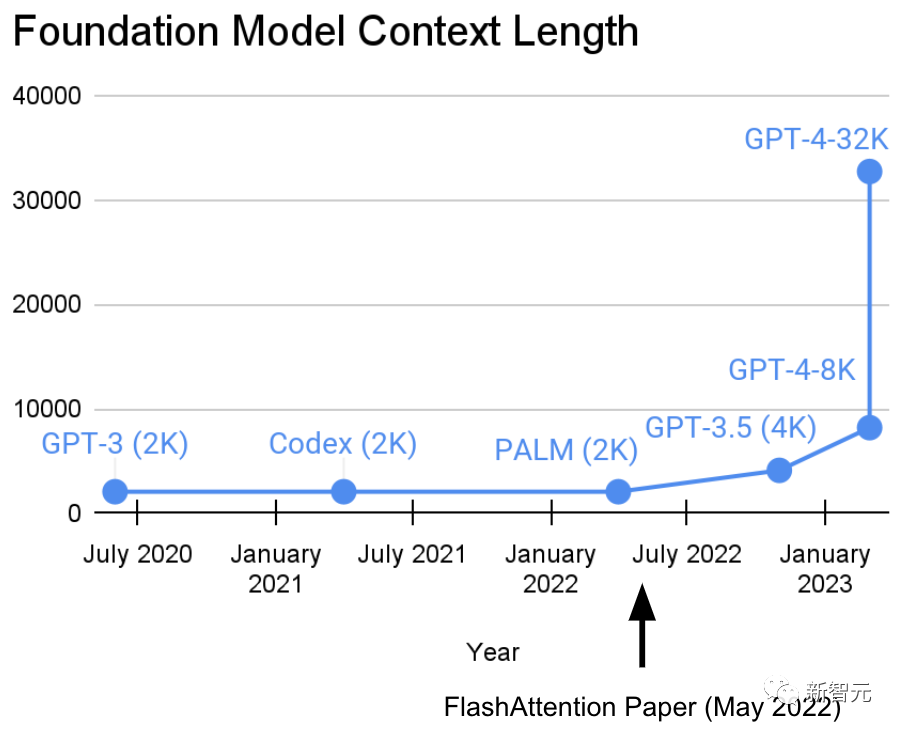

过去几年,斯坦福大学Hazy Research实验室一直在从事一项重要的工作,就是增加模型的序列长度。

研究人员在22年提出的FlashAttention算法证明了32k可行性。

就连Sam Altman称我们要的是32k token。

其实,不仅是32k,现在100k都实现了,百万token也不远了。

「绝对太野了!几年后,支持100万的token上下文长度会不会成为可能?」

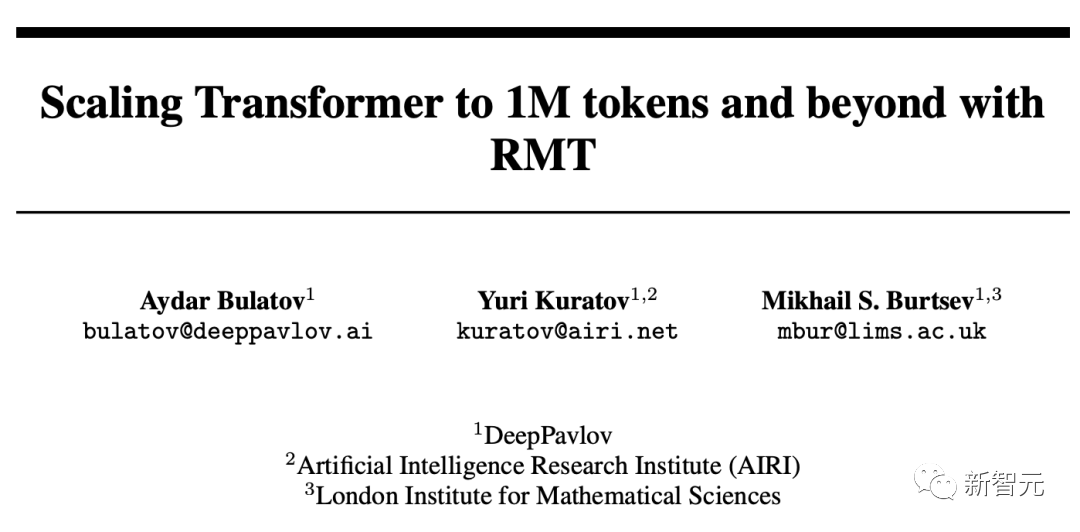

前段时间,来自DeepPavlov、AIRI、伦敦数学科学研究所的研究人员发布了一篇技术报告,使用循环记忆Transformer(RMT)将BERT的有效上下文长度提升到「前所未有的200万tokens」,同时保持了很高的记忆检索准确性。

论文地址:https://arxiv.org/abs/2304.11062

该方法可以存储和处理局部和全局信息,并通过使用循环让信息在输入序列的各segment之间流动。

不过,虽然RMT可以不增加内存消耗,可以扩展到近乎无限的序列长度,但仍然存在RNN中的记忆衰减问题,并且需要更长的推理时间。

具体操作方法是,在不改变原始Transformer模型的前提下,通过在输入或输出序列中添加一个特殊的memory token,然后对模型进行训练以控制记忆操作和序列表征处理。

与Transformer-XL相比,RMT需要的内存更少,并可以处理更长序列的任务。

当然,在最终实现百万token之前,Claude 100k已经是相当大的起步了。

https://www.anthropic.com/index/100k-context-windows

0 条评论